点云处理:基于Paddle2.0实现Kd-Networks对点云进行分类处理

本文介绍基于Paddle2.0实现Kd-Networks对点云分类处理。Kd-Networks引入Kd-Tree结构,将非结构化点云转为结构化数据,用1*1卷积近似KD算子。使用ShapeNet的.h5数据集,经数据处理、网络定义等步骤,训练20轮后,训练集准确率0.978,测试集0.9375,展示了其处理点云分类的效果。

点云处理:基于Paddle2.0实现Kd-Networks对点云进行分类处理

网络简介

Kd-Networks于2017发表于ICCV上。创新性地引入了Kd-Tree结构用于处理点云。

论文:Escape from Cells: Deep Kd-Networks for the Recognition of 3D Point Cloud Models

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

项目效果

训练二十轮后的准确率:

项目说明

①数据集

本次用到的数据集是ShapeNet,储存格式是.h5文件。

.h5储存的key值分别为:

1、data:这一份数据中所有点的xyz坐标,

2、label:这一份数据所属类别,如airplane等,

3、pid:这一份数据中所有点所属的类型,如这一份数据属airplane类,则它包含的所有点的类型有机翼、机身等类型。

②Kd-Networks 简介

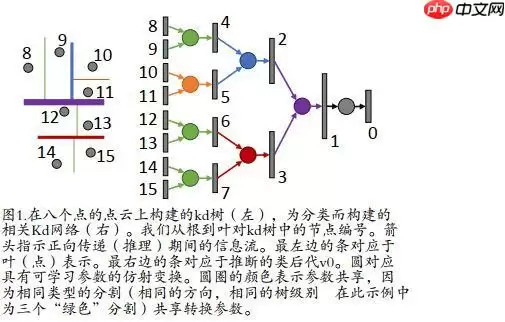

一、Kd-Networks最大的创新点在于引入了Kd-Tree这一结构,Kd-Tree将非结构化点云变成结构化数据,构建了处理非结构化点云的特征工程。

二、该项目利用1*1卷积近似实现KD算子的功能,因此在构建Kd-Networks网络时,构建的是一个类Kd-Tree的网络,也就是说Kd-Networks将数据处理中Kd-Tree化的过程复刻到网络上(例如在index_select处可以看到,index_select复刻的是数据处理时Kd-Tree化中二叉时切割的维度),网络因此类Kd-Tree。

项目主体

①解压数据集、导入需要的库

In [ ]!unzip data/data67117/shapenet_part_seg_hdf5_data.zip!mv hdf5_data dataset登录后复制 In [1]

import osimport numpy as npimport randomimport h5pyimport paddleimport paddle.nn as nnimport paddle.nn.functional as Ffrom tools.build_KDTree import build_KDTree登录后复制

②数据处理

1、生成训练和测试样本的list

In [2]train_list = ['ply_data_train0.h5', 'ply_data_train1.h5', 'ply_data_train2.h5', 'ply_data_train3.h5', 'ply_data_train4.h5', 'ply_data_train5.h5']test_list = ['ply_data_test0.h5', 'ply_data_test1.h5']val_list = ['ply_data_val0.h5']登录后复制

2、数据读取

注:在数据读取这里,可以借助scipy.spatial中的cKDTree很快地生成kdTree。

def pointDataLoader(mode='train'): path = './dataset/' BATCHSIZE = 64 MAX_POINT = 1024 LEVELS = (np.log(MAX_POINT) / np.log(2)).astype(int) datas = [] split_dims_v = [] points_v = [] labels = [] if mode == 'train': for file_list in train_list: f = h5py.File(os.path.join(path, file_list), 'r') datas.extend(f['data'][:, :MAX_POINT, :]) labels.extend(f['label']) f.close() elif mode == 'test': for file_list in test_list: f = h5py.File(os.path.join(path, file_list), 'r') datas.extend(f['data'][:, :MAX_POINT, :]) labels.extend(f['label']) f.close() else: for file_list in val_list: f = h5py.File(os.path.join(path, file_list), 'r') datas.extend(f['data'][:, :MAX_POINT, :]) labels.extend(f['label']) f.close() datas = np.array(datas) for i in range(len(datas)): split_dim, tree = build_KDTree(datas[i], depth=LEVELS) split_dim_v = [np.array(item).astype(np.int64) for item in split_dim] split_dims_v.append(split_dim_v) points_v.append(tree[-1].transpose(0, 2, 1)) split_dims_v = np.array(split_dims_v) points_v = np.array(points_v) labels = np.array(labels) print('==========load over==========') index_list = list(range(len(datas))) def pointDataGenerator(): if mode == 'train': random.shuffle(index_list) split_dims_v_list = [] points_v_list = [] labels_list = [] for i in index_list: split_dims_v_list.append(split_dims_v[i]) points_v_list.append(points_v[i].astype('float32')) labels_list.append(labels[i].astype('int64')) if len(labels_list) == BATCHSIZE: yield np.array(split_dims_v_list), np.array(points_v_list), np.array(labels_list) split_dims_v_list = [] points_v_list = [] labels_list = [] if len(labels_list) > 0: yield np.array(split_dims_v_list), np.array(points_v_list), np.array(labels_list) return pointDataGenerator登录后复制 ③定义网络

In [10]class KDNet(nn.Layer): def __init__(self, k=16): super(KDNet, self).__init__() self.conv1 = nn.Conv1D(3, 32*3, 1, 1) self.conv2 = nn.Conv1D(32, 64*3, 1, 1) self.conv3 = nn.Conv1D(64, 64*3, 1, 1) self.conv4 = nn.Conv1D(64, 128*3, 1, 1) self.conv5 = nn.Conv1D(128, 128*3, 1, 1) self.conv6 = nn.Conv1D(128, 256*3, 1, 1) self.conv7 = nn.Conv1D(256, 256*3, 1, 1) self.conv8 = nn.Conv1D(256, 512*3, 1, 1) self.conv9 = nn.Conv1D(512, 512*3, 1, 1) self.conv10 = nn.Conv1D(512, 128*3, 1, 1) self.fc = nn.Linear(128, k) def forward(self, x, split_dims_v): def kdconv(x, dim, featdim, select, conv): x = F.relu(conv(x)) x = paddle.reshape(x, (-1, featdim, 3, dim)) x = paddle.reshape(x, (-1, featdim, 3 * dim)) select = paddle.to_tensor(select) + (paddle.arange(0, dim) * 3) x = paddle.index_select(x, axis=2, index=select) x = paddle.reshape(x, (-1, featdim, int(dim/2), 2)) x = paddle.max(x, axis=-1) return x x = kdconv(x, 1024, 32, split_dims_v[0], self.conv1) x = kdconv(x, 512, 64, split_dims_v[1], self.conv2) x = kdconv(x, 256, 64, split_dims_v[2], self.conv3) x = kdconv(x, 128, 128, split_dims_v[3], self.conv4) x = kdconv(x, 64, 128, split_dims_v[4], self.conv5) x = kdconv(x, 32, 256, split_dims_v[5], self.conv6) x = kdconv(x, 16, 256, split_dims_v[6], self.conv7) x = kdconv(x, 8, 512, split_dims_v[7], self.conv8) x = kdconv(x, 4, 512, split_dims_v[8], self.conv9) x = kdconv(x, 2, 128, split_dims_v[9], self.conv10) x = paddle.reshape(x, (-1, 128)) x = F.log_softmax(self.fc(x)) return x登录后复制

⑤训练

1、创建训练数据读取器

注:由于训练数据预处理比较慢,所以先创建训练数据读取器(创建同时会对数据进行预处理),这样在训练时候直接导入就显得训练过程快很多(实际上并没有节省时间,只不过是为了调试方便和读者尝试,把训练数据读取器单独拿出来创建)。

train_loader = pointDataLoader(mode='train')登录后复制

==========load over==========登录后复制

2、开始训练

In [11]def train(): model = KDNet() model.train() optim = paddle.optimizer.Adam(parameters=model.parameters(), weight_decay=0.001) epoch_num = 40 for epoch in range(epoch_num): for batch_id, data in enumerate(train_loader()): split_dims_v = data[0] points_v = data[1] labels = data[2] inputs = paddle.to_tensor(points_v) labels = paddle.to_tensor(labels) predict = [] for i in range(split_dims_v.shape[0]): predict.extend(model(inputs[i], split_dims_v[i])) predicts = paddle.stack(predict) loss = F.nll_loss(predicts, labels) acc = paddle.metric.accuracy(predicts, labels) if batch_id % 10 == 0: print("epoch: {}, batch_id: {}, loss is: {}, accuracy is: {}".format(epoch, batch_id, loss.numpy(), acc.numpy())) loss.backward() optim.step() optim.clear_grad() if epoch % 2 == 0: paddle.save(model.state_dict(), './model/KDNet.pdparams') paddle.save(optim.state_dict(), './model/KDNet.pdopt')if __name__ == '__main__': train()登录后复制 ⑥评估

In [12]def evaluation(): test_loader = pointDataLoader(mode='test') model = KDNet() model_state_dict = paddle.load('./model/KDNet.pdparams') model.load_dict(model_state_dict) for batch_id, data in enumerate(test_loader()): split_dims_v = data[0] points_v = data[1] labels = data[2] inputs = paddle.to_tensor(points_v) labels = paddle.to_tensor(labels) predict = [] for i in range(split_dims_v.shape[0]): predict.extend(model(inputs[i], split_dims_v[i])) predicts = paddle.stack(predict) acc = paddle.metric.accuracy(predicts, labels) print("eval accuracy is: {}".format(acc.numpy())) break;if __name__ == '__main__': evaluation()登录后复制 ==========load over==========eval accuracy is: [0.9375]登录后复制

相关攻略

Cardano (ADA) 2026年价格预测:AI深度解析与增长路径 在瞬息万变的加密市场,人工智能分析正成为洞察未来趋势的关键工具。近期,由Grok AI模型发布的Cardano(ADA)2026年价格预测引发了广泛关注,其大胆展望ADA或有望触及两位数美元价格。这不仅彰显了AI数据分析的潜力,

京东“全民养虾计划”:开启AI助手体验新纪元 科技领域近期迎来一场别开生面的创新活动:京东正式推出“全民养虾计划”。表面看,它与美食相关,实际上是一场针对AI智能体技术普及的宏大实验。该计划通过“购买AI硬件、赠送专业安装服务与趣味小龙虾”的组合策略,为当前热门的开源AI智能体——OpenClaw,

![一波资本从以太坊(ETH)流出,进入TRON [TRX]](https://static.youleyou.com//uploadfile/2026/0402/04efc42957db48dcec46c19e60baa121.webp)

以太坊资本外溢:TRON为何成为15 2亿美元稳定币新枢纽? 区块链世界的地壳运动从未停止,资本的流向便是其中最敏锐的震感。近期,一场规模惊人的资本迁徙正在上演:大量资金正从以太坊网络流出,涌入TRON生态。这不仅是简单的资产转移,更是一次深刻的行业风向标,揭示了用户对交易成本、网络效率与应用场景的

自研第一个SKILL:手把手教你开发openclaw自定义技能 当你成功构建好openclaw之后,如何让它真正“智能”起来?关键在于为其开发SKILL——这些技能是openclaw的“内功心法”,决定了它能帮你做什么、做多好。 本文将带你亲自动手,从零开始开发你的第一个openclaw自定义技能,

国产 TOP5 手机厂商被曝联手豆包 打造全新 AI 手机 手机行业再迎重磅 AI 合作!今日,知名数码爆料博主 @数码闲聊站 抛出了“豆包 AI 手机”的议题,并透露其已从内部渠道确认:一家位列国产前五的头部手机厂商,已与字节跳动旗下 AI 产品“豆包”达成深度合作协议。这标志着,AI 手机助理的

热门专题

热门推荐

《全面战争:中世纪3》:经典延续,如何平衡怀旧与创新? 近期,《全面战争:中世纪3》的项目负责人帕维尔·沃伊斯坦然指出,要打造一款真正优秀的续作,绝不能仅仅依赖对前作模式的简单复刻。这一观点引人深思——尽管《中世纪2:全面战争》至今仍在策略游戏爱好者心中占据着经典地位,但开发团队此次显然决心跳出“照

雷鸟X3 Pro斩获AWE艾普兰创新大奖,开启全民AR生活新篇章 在上海新国际博览中心隆重揭幕的2026年中国家电及消费电子博览会(AWE)上,前沿AI科技与未来生活愿景激情碰撞。全球消费级AR领导品牌雷鸟创新,以其里程碑式的表现,定义了行业发展的新方向。 通过“顶尖硬件科技+顶级文化IP”的双轨战

借力AWE2026“一展双区”,MOVA双区协同、震撼登场 备受瞩目的科技盛会——2026年中国家电及消费电子博览会(AWE),于3月12日至15日在上海盛大举办。本届AWE展会首次创新采用“一展双区”的展览模式,主会场位于上海新国际博览中心,分会场则设于上海东方枢纽国际商务合作区,两大展区高效联动

冰结师技能全解析 踏入2026年,《地下城与勇士》中的冰结师职业,其技能体系已构建得更为成熟与强大。无论是在副本中高效清理海量怪物,还是在决斗场与高手玩家周旋,这个职业都能凭借其独特的冰霜艺术掌控战局。刷图时,酷寒的范围法术可瞬间清屏;而在PVP竞技中,一套将冻结控制与瞬间爆发完美衔接的连招,往往让

iPhone 18 Pro系列模具不变,屏幕形态将与iPhone 17 Pro保持一致 备受期待的屏下Face ID组件小型化设计与灵动岛区域缩窄方案,预计将被推迟至后续迭代机型中正式应用。 近期,关于iPhone 18 Pro系列的技术传闻持续引发行业关注,尤其在显示与解锁设计领域传言甚多。多方消