一个项目体验stable-diffusion、waifu、NovelAI三大模型

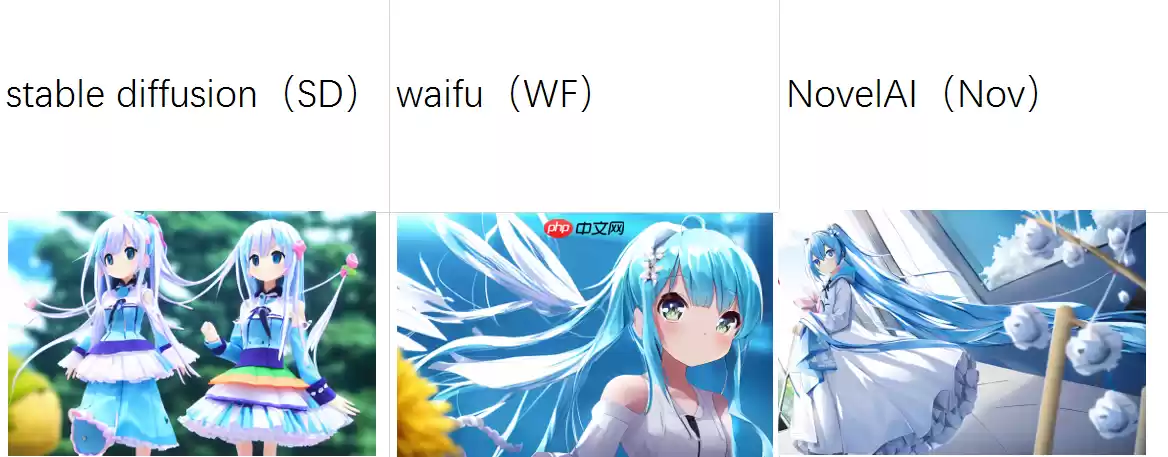

该项目可在一个项目中切换Stable Diffusion、waifu、NovelAI三大模型及权重,支持载入自主训练模型。进入Notebook后按步骤运行代码,含解压模型、安装库等,可实现文生图、图生图、超分等功能,也可批量生成,还介绍了参数、常见问题及非界面版玩法,方便用户集中操作。

一个项目体验stable-diffusion、waifu、NovelAI三大模型!

Stable Diffusion、waifu、NovelAI三大模型及其权重 ,可以使用最基本模型权重组合,也同时可载入自主训练的模型(),模型无限创作无限。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

有问题的话, 讨论区留言。

已知问题NovelAI 模型中CFG暂时无效果自训练模型中negative_prompt暂时无效果

一、进入 Notebook

点击“运行一下”后,点击“启动环境”,选择合适的 GPU,进入项目。 AIStudio 每天自动赠送 8 小时的 GPU 算力。更厉害的 GPU 可以生成更大的图片。

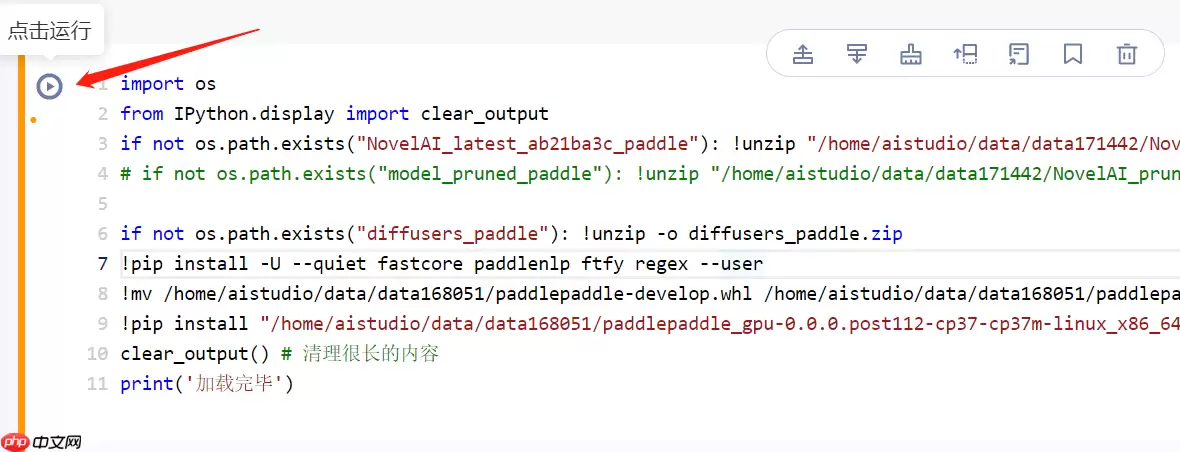

二、代码开始第一步 运行下面的代码!

进入之后,点击下边的框里左上角的“点击运行”(或者点进下面的框内用快捷键 Ctrl + Enter)

下面的代码只用在你第一次进入时运行!

下面的代码里在云环境里解压了模型文件,并且自动安装了各个文件。

等到显示“加载完毕”即可。如果中间可能出现红字:ERROR:pip's .... 这个不用管,会自动继续。

(理想不超过7分钟,太慢可先用CPU环境解压,解压完了再换回GPU环境,或者去讨论区进入交流群)

In [1]#下面的只能生成512 x 1024 的图,再大像素会报错 ,第一次运行后记得重启 ,第一次运行后记得重启 ,第一次运行后记得重启 import osfrom IPython.display import clear_outputfrom utils import check_is_model_completeprint('正在解压模型')if not check_is_model_complete("./NovelAI_latest_ab21ba3c_paddle"): # 解压 latest 模型 !unzip -o "/home/aistudio/data/data171442/NovelAI_latest_ab21ba3c_paddle.zip" # if not check_is_model_complete("./model_pruned_paddle"): # full 模型# !unzip -o "/home/aistudio/data/data171442/NovelAI_pruned_paddle.zip"if not os.path.exists("diffusers_paddle"): !unzip -o diffusers_paddle.zipprint('正在安装库')!pip install --upgrade pip -i https://mirror.baidu.com/pypi/simple!pip install -U fastcore paddlenlp ftfy regex --user -i https://mirror.baidu.com/pypi/simple!pip install --upgrade paddlenlp -i https://mirror.baidu.com/pypi/simpleprint('正在安装新版飞桨')# 如果需要生成 768 x 1024 则去掉下两行开头的井号运行一次 (运行成功一次即可), 但是可能卡, 建议挑人少的时候#!mv /home/aistudio/data/data168051/paddlepaddle-develop.whl /home/aistudio/data/data168051/paddlepaddle_gpu-0.0.0.post112-cp37-cp37m-linux_x86_64.whl#!pip install "/home/aistudio/data/data168051/paddlepaddle_gpu-0.0.0.post112-cp37-cp37m-linux_x86_64.whl" --userclear_output() # 清理很长的内容print('加载完毕, 下次不用再运行这里了')登录后复制 加载完毕, 下次不用再运行这里了登录后复制

重新启动项目也从这里开始

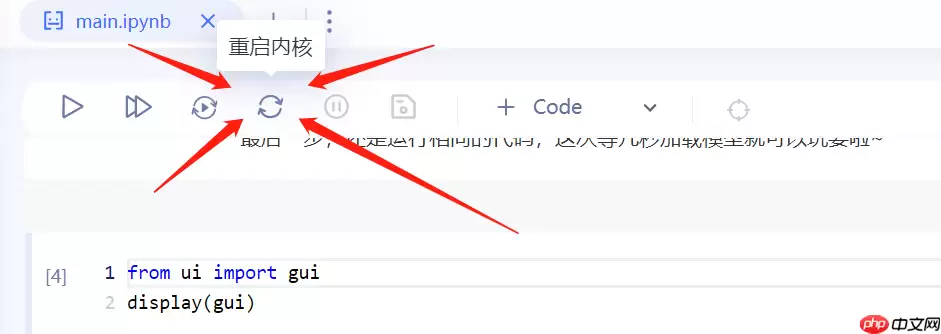

三、重启内核! 重新启动项目也从这里开始

点击上边栏的“重启内核” 重启内核图:

四、下载及解压SD预训练模型及waifu模型!

最后一步,点击左上角的“点击运行”运行下面的代码,等几秒加载模型就可以玩耍啦~ 以后每次进来直接运行下面这个就行啦~

In [ ]# 下载及解压SD预训练模型及waifu模型 ,可能需要比较长的时间import osif not os.path.exists("CompVis-stable-diffusion-v1-4"): !wget https://paddlenlp.bj.bcebos.com/models/community/CompVis/stable-diffusion-v1-4/CompVis-stable-diffusion-v1-4.tar.gz !tar -zxvf CompVis-stable-diffusion-v1-4.tar.gz !rm -rf CompVis-stable-diffusion-v1-4.tar.gzif not os.path.exists("waifu-diffusion"): !wget https://bj.bcebos.com/paddlenlp/models/community/hakurei/waifu-diffusion/waifu-diffusion.tar.gz #waifu-diffusion-v1-2 !tar -zxvf waifu-diffusion.tar.gz !rm -rf waifu-diffusion.tar.gz #!wget https://paddlenlp.bj.bcebos.com/models/community/hakurei/waifu-diffusion/waifu-diffusion-v1-3.tar.gz #waifu-diffusion-v1-3 注意下面移动和解压 #!tar -zxvf waifu-diffusion-v1-3.tar.gz #!rm -rf waifu-diffusion-v1-3.tar.gz !unzip -o "data/data168051/stable-diffusion-v1-4.zip" !unzip -o "sd-concepts-library.zip"# if not os.path.exists("trinart_stable_diffusion_v2_95k"):# !wget https://bj.bcebos.com/paddlenlp/models/community/naclbit/trinart_stable_diffusion_v2/trinart_stable_diffusion_v2_95k.tar.gz# !tar -zxvf trinart_stable_diffusion_v2_95k.tar.gz# !rm -rf trinart_stable_diffusion_v2_95k.tar.gz登录后复制 核心重启及项目重启后从这里开始 执行

In [17]# 模型和权重加载都在这里,pipe 加载的权重,vae_path 加载的本体,如果第一次运行下面报错, 就重启内核重新运行一次from diffusers_paddle import StableDiffusionPipeline, StableDiffusionImg2ImgPipelineimport paddlefrom utils import save_image_infoimport ospipe = StableDiffusionPipeline.from_pretrained("./CompVis-stable-diffusion-v1-4") # 加载SD默认权重#pipe = StableDiffusionPipeline.from_pretrained("./waifu-diffusion") # 加载waifu权重#pipe = StableDiffusionPipeline.from_pretrained("./NovelAI_latest_ab21ba3c_paddle") # 加载NovelAI权重# pipe = StableDiffusionPipeline.from_pretrained("./model_pruned_paddle")vae_path = 'stable-diffusion-v1-4/model_state.pdparams' # 加载 SD默认 模型#vae_path = 'waifu-diffusion/unet/model_state.pdparams' # 加载 waifu 模型#vae_path = './NovelAI_latest_ab21ba3c_paddle/vae/animevae.pdparams' # 加载 NovelAI vae 模型pipe.vae.load_state_dict(paddle.load(vae_path)) # 换用更好的 vae (有效果!)# 图生图pipe_i2i = StableDiffusionImg2ImgPipeline(vae=pipe.vae,text_encoder=pipe.text_encoder,tokenizer=pipe.tokenizer,unet=pipe.unet,scheduler=pipe.scheduler,safety_checker=pipe.safety_checker,feature_extractor=pipe.feature_extractor)print('加载完毕')登录后复制 加载完毕登录后复制 In [1]

from ui import gui_txt2img # 文生图display(gui_txt2img.gui) # 生成的图片自动保存到左侧的 outputs 的文件夹里登录后复制

VBox(children=(Textarea(value='extremely detailed CG unity 8k wallpaper,black long hair,cute face,1 adult girl…登录后复制 In [3]

from ui import gui_img2img # 图生图, 在左侧上传图片, 然后修改 "需要转换的图片路径"display(gui_img2img.gui) # 生成的图片自动保存到左侧的 outputs 的文件夹里登录后复制

VBox(children=(Textarea(value='Kurisu Makise, looking at viewer, long hair, standing, 1girl, hair ornament, ha…登录后复制 In [2]

from ui import gui_superres # 超分 (图片放大一倍), 在左侧上传图片, 然后修改 "需要超分的图片路径"display(gui_superres.gui) # 生成的图片自动保存到左侧的 outputs 的文件夹里登录后复制

VBox(children=(Text(value='image_Kurisu.webp', description='需要超分的图片路径', layout=Layout(width='100%'), style=Desc…登录后复制

常见问题

Q: 加载文件 main.ipynb 时出错 failed to fetch 错误是什么问题?

A:项目文件比较大有可能是挂载的问题,需要重新退出项目后再点启动项目试试,10.15后的版本已精简main文件。重新进入项目因加载模型过多各文件下的图片可能依然存在failed to fetch 错误,直接生成新图片即可.退出项目时记得保存生存图片并清理特定文件夹 同时清除全部输出!!!

Q: 能不能用使用自己训练的模型啊?

A: 可以的, 这里有2种训练方法https://aistudio.baidu.com/aistudio/projectdetail/4592929?channelType=0&channel=0。 直接把模型上传到sd-concepts-library 文件里后 就能使用,后期考虑添加相关的2种训练方法 inversion 和dreambooth 方法

Q: 能不能用中文描述啊?

A: 可以的, 但是效果不如英文。因为模型是用英语文本训练的。(可以去翻译软件里翻译一下)

Q: 生成的图怎么都一样的?

A: 如果设定了相同的随机数种子且其它参数相同,则生成的图也是一样的。

Q: 生成的时候进度条卡住, 然后弹出一个框框:The kernel for main.ipynb appears to have died. It will restart automatically.?

A: 生成图片尺寸太大了!可以重启内核改用较小的尺寸,或者重新进入更换更大的 GPU。

Q: 其它神秘问题?

A: 请去评论区进讨论群。如果是默认的参数无法生成,可以删除该项目重新 Fork 一份从头开始。

非界面版 (推荐)

如果你不满足于上面的界面玩法, 那么不妨来试试下面的部分!(下面有图生图哦)

如果第一次运行下面报错, 不要惊慌!重启内核重新运行一次!

文生图

参数:

height 图片高度 (常用 512,768,1024等)width 图片宽度 (常用 512,768,1024等)seed 随机数种子(如果是None则为自动随机)steps 生成步数cfg 引导比例prompt 描述内容negative_prompt 反面描述内容注:生成图片尺寸越大, 则需要时间越久

注: 描述内容太长的话, 可以用右斜线 \ 换行.

生成的图都在 outputs 文件夹里。

In [ ]height = 512width = 768seed = 3354985548steps = 50cfg = 7 prompt = "miku, looking at viewer, long hair, standing, 1girl, hair ornament, hair flower, cute, jacket, white flower, white dress 精灵耳朵"#negative_prompt = "{mucha},{extremely detailed 4K CG},{original}, {{masterpiece}},lowres, bad anatomy, bad hands, text, error, missing fingers, extra digit, fewer digits, \#cropped, worst quality, low quality, normal quality, jpeg artifacts, signature, watermark, username, blurry"image = pipe(prompt,height=height,width=width,num_inference_steps=steps,guidance_scale=cfg,seed=seed,negative_prompt=negative_prompt).images[0]print('Seed =', image.argument['seed'])display(image)save_image_info(image, path = './jpgout/') # 保存图片到指定位置登录后复制 In [3]image.argument # 查看图片生成使用的参数登录后复制

{'prompt': 'miku, looking at viewer, long hair, standing, 1girl, hair ornament, hair flower, cute, jacket, white flower, white dress', 'height': 512, 'width': 768, 'num_inference_steps': 50, 'guidance_scale': 7, 'negative_prompt': 'lowres, bad anatomy, bad hands, text, error, missing fingers, extra digit, fewer digits, cropped, worst quality, low quality, normal quality, jpeg artifacts, signature, watermark, username, blurry', 'eta': 0.0, 'seed': 1835537382, 'latents': None}登录后复制 批量文生图

参数:

number 生成图片数量注:批量就不要设置种子, 否则出来的图都一样。

生成的图都在 outputs 文件夹里。

In [ ]# 批量文生图number = 2height = 768 width = 512steps = 50cfg = 17.5 prompt = "kitsune made out of flames, digital art, synthwave . "negative_prompt = "{mucha},{extremely detailed 4K CG},{original}, {{masterpiece}},lowres, bad anatomy, bad hands, text, error, missing fingers, extra digit, fewer digits, cropped, worst quality, low quality, normal quality, jpeg artifacts, signature, watermark, username, blurry"for i in range(number): image = pipe(prompt,height=height,width=width,num_inference_steps=steps,guidance_scale=cfg,negative_prompt=negative_prompt).images[0] save_image_info(image, path = './jpgout/') display(image)登录后复制 In [ ]# 批量文生图number = 2height = 768 width = 512steps = 50cfg = 17.5 prompt = "kitsune made out of flames, digital art, synthwave . "negative_prompt = "lowres, bad anatomy, bad hands, text, error, missing fingers, extra digit, fewer digits, cropped, worst quality, low quality, normal quality, jpeg artifacts, signature, watermark, username, blurry"for i in range(number): image = pipe(prompt,height=height,width=width,num_inference_steps=steps,guidance_scale=cfg,negative_prompt=negative_prompt).images[0] save_image_info(image, path = './jpgout/') display(image)登录后复制

图生图

参数:

path 图片路径 (在左边上传图片)steps 生成步数seed 随机数种子 (如果是 None 则为自动随机)strength 修改强度 (默认 0.8)cfg 引导比例 (默认 7.5)prompt 描述内容negative_prompt 反面描述内容注: 描述内容太长的话, 可以用右斜线 \ 换行.

生成的图都在 outputs 文件夹里。

In [ ]path = "image_Kurisu.webp"steps = 50seed = 20241008strength = 0.8cfg = 7.5prompt = "kitsune made out of flames, digital art, synthwave "negative_prompt = "lowres, bad anatomy, bad hands, text, error, missing fingers, extra digit, fewer digits, cropped, worst quality, low quality, normal quality, jpeg artifacts, signature, watermark, username, blurry" from utils import ReadImageinit_image = ReadImage(path, height=-1, width=-1) # -1 为自动判断图片大小image2 = pipe_i2i(prompt,init_image=init_image,num_inference_steps=steps,strength=strength,guidance_scale=cfg,seed=seed,negative_prompt=negative_prompt)[0][0]print('Seed =', image2.argument['seed'])display(image2)save_image_info(image2, path = './outputs/') # 保存图片到指定位置登录后复制 In [9]image2.argument # 查看图片生成使用的参数登录后复制

{'prompt': 'Kurisu Makise', 'init_image': , 'strength': 0.8, 'num_inference_steps': 50, 'guidance_scale': 7.5, 'negative_prompt': 'lowres, bad anatomy, bad hands, text, error, missing fingers, extra digit, fewer digits, cropped, worst quality, low quality, normal quality, jpeg artifacts, signature, watermark, username, blurry', 'eta': 0.0, 'seed': 20241008} 登录后复制  ### 批量图生图

### 批量图生图

参数:

number 生成图片数量注:批量就不要设置种子, 否则出来的图都一样。

生成的图都在 outputs 文件夹里。

In [ ]number = 10path = "https://www.youleyou.com/uploadfile/2025/0721/20250721120540511.webp" #替换了一个网络图片steps = 50strength = 0.8cfg = 13.5prompt = "miku is Sitting on a wooden chair with porcelain on a wooden multi-purpose shelf behind her while With incense burner at the top of the shelf, looking at viewer, long hair, standing, 1girl, hair ornament, hair flower, cute, jacket, white flower, white dress"negative_prompt = "lowres, bad anatomy, bad hands, text, error, missing fingers, extra digit, fewer digits, cropped, worst quality, low quality, normal quality, jpeg artifacts, signature, watermark, username, blurry" from utils import ReadImageinit_image = ReadImage(path, height=-1, width=-1) # -1 为自动判断图片大小for i in range(number): image2 = pipe_i2i(prompt,init_image=init_image,num_inference_steps=steps,strength=strength,guidance_scale=cfg,negative_prompt=negative_prompt)[0][0] save_image_info(image2, path = './outputs/') display(image2)登录后复制

训练模型生图

直接用了 凉心半浅良心人的代码**需要自己训练自己对象和风格的 直接点 **

Stable Diffsuion textual_inversion训练

https://aistudio.baidu.com/aistudio/projectdetail/4592929?channelType=0&channel=0

In [ ]learned_embeded_path = "sd-concepts-library/Marc_Allante-style.pdparams"for token, embeds in paddle.load(learned_embeded_path).items(): pipe.tokenizer.add_tokens(token) pipe.text_encoder.resize_token_embeddings(len(pipe.tokenizer)) token_id = pipe.tokenizer.convert_tokens_to_ids(token) with paddle.no_grad(): pipe.text_encoder.get_input_embeddings().weight[token_id] = embedsprompt = f"a colorful color painting of {token} styles ,kitsune made out of flames, digital art, synthwave. " #如果不是图片风格是物体 使用a photo of a {token}# negative_prompt = "lowres, bad anatomy, bad hands, text, error, missing fingers, extra digit, fewer digits, cropped, worst quality, low quality, normal quality, jpeg artifacts, signature, watermark, username, blurry"num_samples = 1 #图片数量 images = pipe([prompt] * num_samples, height=704, width=512, num_inference_steps=50 , guidance_scale=7.5,seed=1788937216).imagesfor img in images: display(img) save_image_info(img, path = './learnout/')登录后复制

learned_embeded_path = "sd-concepts-library/hitokomoru-style.pdparams"for token, embeds in paddle.load(learned_embeded_path).items(): pipe.tokenizer.add_tokens(token) pipe.text_encoder.resize_token_embeddings(len(pipe.tokenizer)) token_id = pipe.tokenizer.convert_tokens_to_ids(token) with paddle.no_grad(): pipe.text_encoder.get_input_embeddings().weight[token_id] = embedsprompt = f"a colorful color painting of {token} styles ,kitsune made out of flames, digital art, synthwave. "# negative_prompt = "lowres, bad anatomy, bad hands, text, error, missing fingers, extra digit, fewer digits, cropped, worst quality, low quality, normal quality, jpeg artifacts, signature, watermark, username, blurry"num_samples = 1 #图片数量 images = pipe([prompt] * num_samples, height=704, width=512, num_inference_steps=50, guidance_scale=17.5,seed=2788937216).imagesfor img in images: display(img)登录后复制

自训练模型批量图生图

参数:

pipe 加载的权重learned_embeded_patnumg = 50 #生成图片数量注:批量就不要设置种子, 否则出来的图都一样。

生成的图都在 outputs 文件夹里。

In [ ]# 加载权重文件pipe = StableDiffusionPipeline.from_pretrained("./waifu-diffusion")#pipe = StableDiffusionPipeline.from_pretrained("./CompVis-stable-diffusion-v1-4")#pipe = StableDiffusionPipeline.from_pretrained("./NovelAI_latest_ab21ba3c_paddle")# 加载sd-concepts-library中的训练模型 learned_embeded_path = "sd-concepts-library/huang-guang-jian-style.pdparams"登录后复制 In [ ]# 自训练模型生成多张图片for token, embeds in paddle.load(learned_embeded_path).items(): pipe.tokenizer.add_tokens(token) pipe.text_encoder.resize_token_embeddings(len(pipe.tokenizer)) token_id = pipe.tokenizer.convert_tokens_to_ids(token) with paddle.no_grad(): pipe.text_encoder.get_input_embeddings().weight[token_id] = embedsimport timetimestring = time.strftime('%Y%m%d%H%M%S') #a colorful painting of {token} styles,prompt = f"a colorful color painting of {token} styles ,kitsune made out of flames, digital art, synthwave. "negative_prompt = "lowres, bad anatomy, bad hands, text, error, missing fingers, extra digit, fewer digits, cropped, worst quality, low quality, normal quality, jpeg artifacts, signature, watermark, username, blurry"numg = 50 #图片数量 num_samples = 1for _ in range(numg): with paddle.no_grad(): image = pipe([prompt] * num_samples,num_inference_steps=100,width=1024,height=512,negative_prompt=[negative_prompt],guidance_scale=13.5).images[0] timestring = time.strftime('%Y%m%d%H%M%S') image.save(f"./learnout/{timestring}_.webp") # image.save(f"./jpg/{timestring}.webp") with open(f'./learnout/{timestring}.txt', 'w') as f: print(image.argument,file = f) display(image.argument) display(image)登录后复制 清理特定文件夹

确保已经下载该文件 且压缩文件能正常打开

如果清理后退出内核,需要清除本文档的全部输出 避免加载出错会清空相应文件夹下所有文件 运行前务必保存 ,运行前务必保存,运行前务必保存打包下载100M以上的文件有可能出现压缩包错误,所以就算下载后也务必检查 避免删除没保存的图In [31]# 清理文件夹使用 确保已经下载文件#删除文件夹下面的所有文件(只删除文件,不删除文件夹)import osimport shutil#python删除文件的方法 os.remove(path)path指的是文件的绝对路径,如:def del_file(path_data): for i in os.listdir(path_data) :# os.listdir(path_data)#返回一个列表,里面是当前目录下面的所有东西的相对路径 file_data = path_data + "/" + i#当前文件夹的下面的所有东西的绝对路径 if os.path.isfile(file_data) == True:#os.path.isfile判断是否为文件,如果是文件,就删除.如果是文件夹.递归给del_file. os.remove(file_data) else: del_file(file_data)#path_data = r"jpgout" # 删除TXT 生成的文件path_data = r"outputs" #删除图生图 生成的文件#path_data = r"learnout" #删除自训练文生图 生成的文件del_file(path_data)登录后复制

相关攻略

4月6日消息,诞生37年的Intel486处理器,即将彻底告别现代Linux系统。据科技媒体Phoronix报道,Linux内核开发者已启动对486处理器支持的移除工作,相关补丁确认将合入Linux

Win11 → WSL2 → Ubuntu → OpenClaw 的直接流程 想在 Windows 上顺畅地用上 OpenClaw?其实核心就一条:先在 WSL2 里搭好 Ubuntu 这个“标准环境”。下面这个流程,你按顺序一步步执行就行,能避开不少弯路。 第一步:安装 WSL2 与 Ubuntu

参考指南与学习资料 若您希望在本地快速搭建并部署一个个人智能助手,OpenClaw 框架是一个理想的入门选择。为了帮助开发者更高效地上手,社区中已有丰富的学习资源与讨论可供参考,主要包括:OpenClaw 新手入门教程、核心命令行工具使用指南(openclaw -h 查看帮助)、配置文件的参数详解,

1 openclaw 工具权限报错解决方案:无法使用 exec read write webfetch 等工具的修复方法 当您在配置 openclaw 时遇到工具权限报错,提示缺少 exec、read、write、webfetch 等关键工具的使用权限,通常无需深入排查复杂的系统环境。此问题在多数

本次部署指南的核心目标非常明确:在 Linux 环境中,无论是云服务器还是本地物理机,我们都需要完整地完成 OpenClaw 智能体框架的安装与部署,并通过基础的健康检查与功能验证,确保整个系统能够成功启动并稳定运行。 一、环境要求 在开始动手安装之前,我们首先需要确认系统满足所有的基础运行环境要求

热门专题

热门推荐

加密货币行业翘首以盼的监管里程碑,终于有了实质性进展。美国证券交易委员会(SEC)主席保罗·阿特金斯(Paul Atkins)近日证实,那份允许加密项目在早期获得注册豁免权的“安全港”框架提案,已经正式送抵白宫,进入了最终审查阶段。 在范德堡大学与区块链协会联合举办的数字资产峰会上,阿特金斯透露了这

微策略Strategy报告:第一季录得144 6亿美元浮亏 再斥资约3 3亿美元买进4871枚比特币 市场震荡的威力有多大?看看Strategy的最新季报就明白了。根据其最新向美国证管会(SEC)提交的8-K报告,受市场剧烈波动影响,这家公司所持的比特币在第一季度录得了一笔惊人的数字——144 6亿

稳定币巨头Tether的动向,向来是加密世界的风向标。这不,它向Web3基础设施的版图扩张,又迈出了关键一步。公司执行长Paolo Ardoino在社交平台X上透露,其工程团队正在全力“烹制”一个新项目——去中心化搜索引擎 “Hypersearch”。这个消息一出,立刻引发了行业的广泛猜想。 采用D

基地位于Coinbase旗下以太坊Layer2网络Base的Seamless Protocol,日前正式宣告了服务的终结。这个曾经吸引了超过20万用户的原生DeFi借贷协议,在运营不到三年后,终究没能跑赢时间。它主打的核心产品是Integrated Leverage Markets(ILMs)——一

PAAL代币揭秘:深度解析Web3社区治理的核心钥匙 在去中心化自治组织的浪潮中,谁真正掌握了项目的话语权?PAAL代币提供了一套系统化的答案。它不仅是生态内流转的价值媒介,更是开启链上治理大门的核心凭证。通过持有并质押PAAL代币,用户能够对协议升级、资金分配乃至战略方向等关键事务投出决定性的一票