试卷手写笔迹擦除 -- 百度网盘AI大赛:手写文字擦除第5名方案

该方案为百度网盘AI大赛手写文字擦除第5名方案,基于SegFormer语义分割模型实现试卷手写笔迹擦除。通过生成手写笔迹分割掩码,再利用掩码去除笔迹。处理数据集时生成二分类掩码、预处理图像并增强数据。改进SegFormer的decoder,采用转置卷积,结合交叉熵与Dice损失函数,提升效果。

试卷手写笔迹擦除

-- 百度网盘AI大赛:手写文字擦除第5名方案

一、简介

1. 项目介绍

本项目基于 SegFormer 语义分割模型,识别试卷中的手写笔迹来生成去除掩码,实现 AI 笔迹橡皮擦,擦除试卷中的手写笔迹。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

2. 项目背景

本项目源于百度网盘的图像处理挑战赛,手写文字擦除任务。 百度网盘AI大赛——图像处理挑战赛是百度网盘开放平台 面向AI开发者和爱好者发起的计算机视觉领域挑战赛。AI时代已到来,百度网盘与百度飞桨AI Studio强强联合,旨在基于个人云存储的生态能力开放,通过比赛机制,鼓励选手结合当下前沿的计算机视觉技术与图像处理技术,完成模型设计搭建与训练优化,产出基于飞桨框架的开源模型方案,为中国开源生态建设贡献一份力量。 本次图像处理挑战赛以线上比赛的形式进行,参赛选手需要在规定时间内,完成模型设计搭建与训练优化,并提交基于评测数据集产出的结果文件

3. 赛题分析

赛题描述:选手需要建立模型,对比赛给定的带有手写痕迹的试卷图片进行处理,擦除相关的笔,还原图片原本的样子,并提交模型输出的结果图片。 思路分析:试卷中存在的痕迹可以视为印刷和手写两类,手写字体的笔迹往往不够规整,在整体结构上不如印刷体的分明,因此我们可以将手写体和印刷体视为两种不同结构的语义类别,用语义分割模型对其处理,获得手写笔记的分割mask。但是大多数语义分割模型往往生成较为粗糙的 mask,我们需要对模型的 decoder 进行一定改动设计。

赛题分析

赛题描述:选手需要建立模型,对比赛给定的带有手写痕迹的试卷图片进行处理,擦除相关的笔,还原图片原本的样子,并提交模型输出的结果图片。思路分析:试卷中存在的痕迹可以视为印刷和手写两类,手写字体的笔迹往往不够规整,在整体结构上不如印刷体的分明,因此我们可以将手写体和印刷体视为两种不同结构的语义类别,用语义分割模型对其处理,获得手写笔记的分割mask。但是大多数语义分割模型往往生成较为粗糙的 mask,我们需要对模型的 decoder 进行一定改动设计。二、数据集介绍及处理

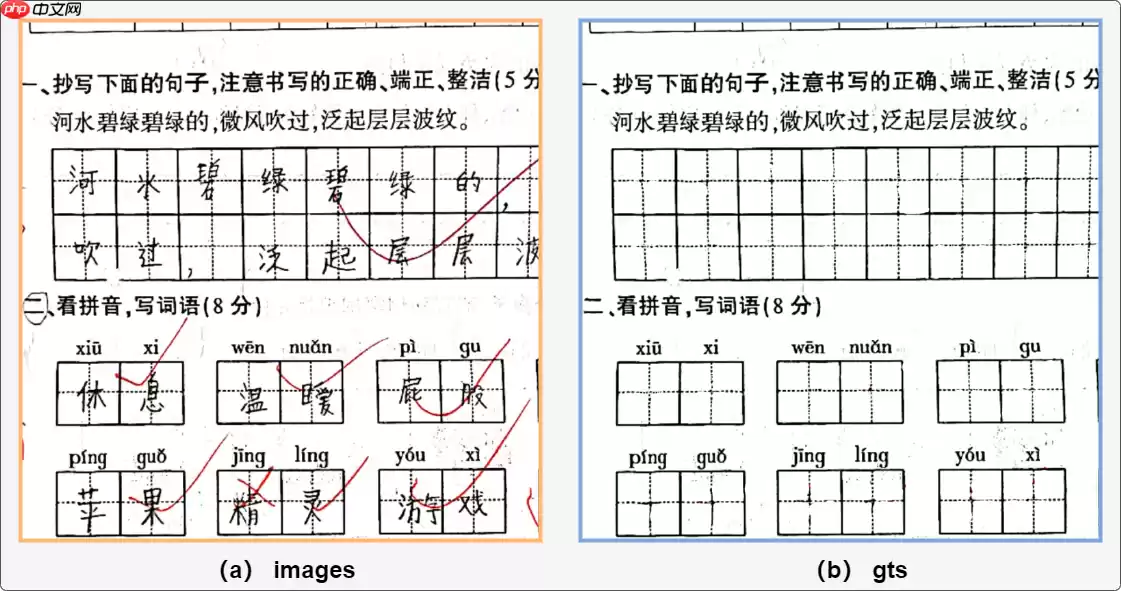

本次比赛最新发布的数据集中,所有的图像数据均由真实场景采集得到,再通过技术手段进行相应处理,生成可用的脱敏数据集。该任务为image-to-image的形式,因此源数据和GT数据均以图片的形式来提供。其中训练集有1000个样本,测试集A榜和B榜各200个样本训练数据集。训练数据集结构如下:

|- root |- images |- gts登录后复制

images 手写文字的源图像数据,gts 为无手写文字的真值数据(仅有训练集数据提供gts ,A榜测试集、B榜测试集数据均不提供gts);

images 与 gts 中的图片根据图片名称一一对应。

上图为训练集中的一对样本,我们可以观察得到以下三点特征:

需要去除的手写痕迹在结构上比较的精细,而且大小区别很大虽然存在需要大量去除的痕迹,但是与整张图片比较,区域占比相对还是比较小手写痕迹存与印刷痕迹存在耦合,这对于完整结构的识别与分割提出了挑战数据集处理

依据我们的设计,数据集处理分为以下部分:

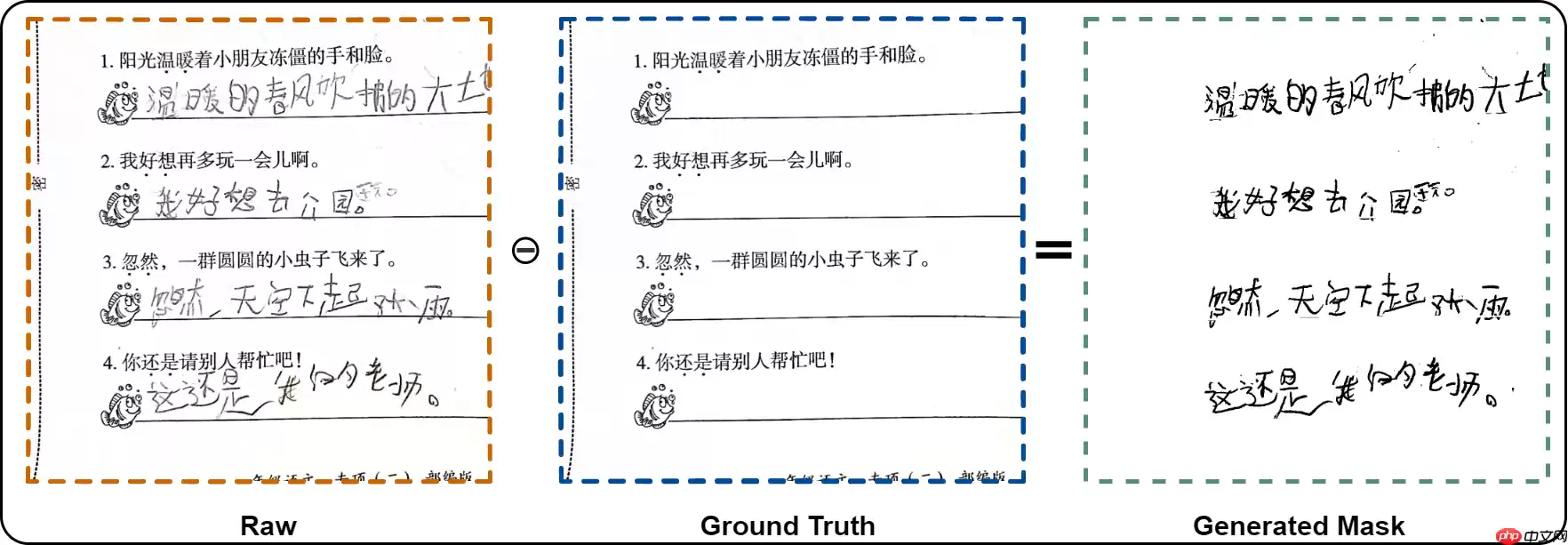

Mask 生成:由于我们采用语义分割框架,我们需要生成二分类掩码的真实值。我们通过对比去除文字后和去除文字前的图像,对于大于设定阈值的地方,我们认为是需要除去的部分,置为 1 值,其余置为 0 值,以此生成 Mask,如下图所示:

三、模型设计

我们把笔记擦除任务视为笔迹识别并生成掩码的任务,而这恰好是语义分割所擅长的,因此我们考虑采用基于语义分割的 SOTA 模型--Segformer 来进行文字擦除。

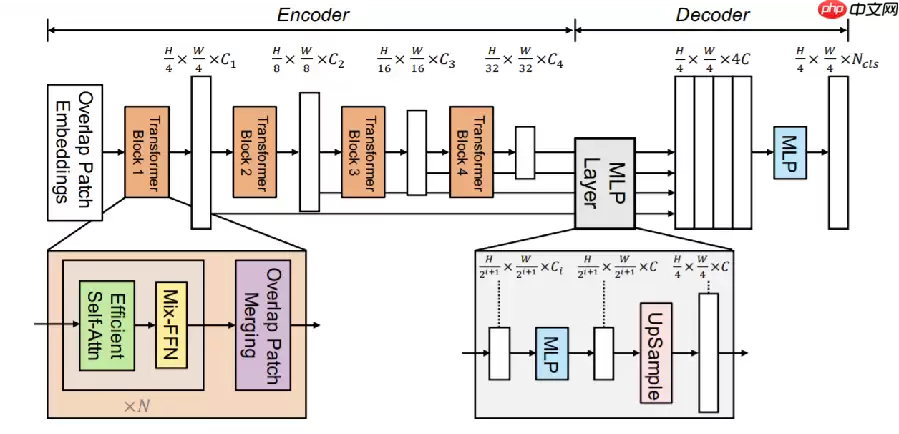

SegFormer: Encoder - Decoder 结构,Encoder 捕获充足的上下文语义信息,Decoder 进行上采样得到像素分割掩码(但原文设计中最终只得到原图 4x 下采样的语义分割结果,需要上采样回去到输入图像的尺寸)。Encoder 由Transformer Block 组成,形成结构化特征表征;Decoder 由 MLP 组成,聚合不同尺度信息。整体框架如下所作:

SegFormer 设计的特点:

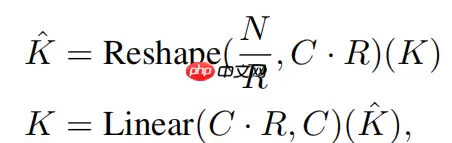

Efficient Self-Attn:通过将空间局部信息转化为通道信息,高效自注意力层将原始自注意力层 O(N2) 的计算复杂度降为了 O(RN2) ,同时通过这一操作还实现了全局--局部信息的交互,强化了信息提取能力。

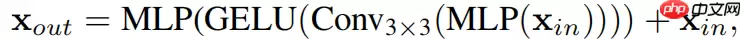

Mix-FFN:SegFormer 放弃了 Transformer 原始的位置编码,利用 MLP 和 3×3 卷积编码来实现局部位置信息的感知,从而能够更加灵活适应多种分辨率图像的输入,捕捉不同尺度的信息。

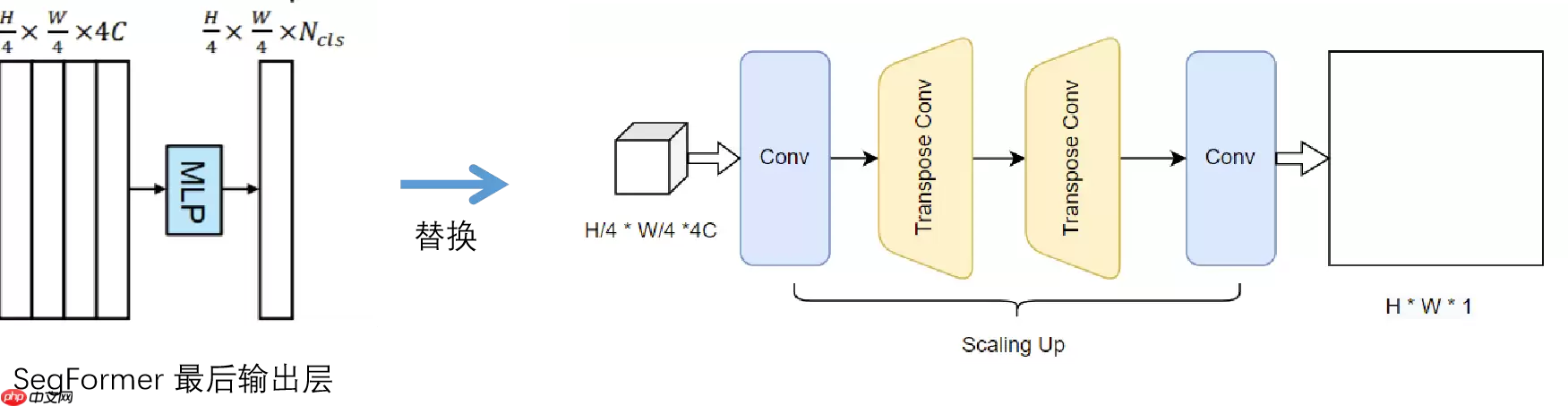

Lightweight All-MLP Decoder:SegFormer 的 Decoder 仅由 MLP 和无参数上采样层组成,作者提出由于编码器中自注意力层的存在,在解码器中无需再设计复杂的模块(如Dilated Convolution 和 ASPP 设计)来扩大模型有效感受野,因此用 MLP 层进行信息融合即可。当然这也有一定弊端,无参数上采样层无法很好利用局部信息来插值,导致分割结果的边缘可能不够精细化。

*详见 SegFormer: Simple and Eicient Design for Semantic Segmentation with Transformers

模型改进

试卷中的文字一般是精细化的结构,而 SegFormer 产生的掩码相对粗糙,不利于去除手写的文字痕迹,我们考虑采用可学习的转置卷积,通过局部区域特征上采样,不断补充精细结构来生成掩码结果,相较于无参数的上采样(如双线性插值),能够更好利用局部信息进行更高阶上采样。

损失函数设计

一般的语义分割任务中的对象往往大尺寸的结构占主体,因此交叉熵损失就足够解决问题;但是手写痕迹的细化结构,会导致交叉熵损失效果不能起到最好效果,因此我们在交叉熵损失基础上还加入了 dice loss 针对细化结构进行有效惩罚。

Dice=∣X∣+∣Y∣2∣X⋃Y∣

Ldice=1−Dice

其中 X⋃Y 表示求取 X 和 Y 的并集。最终的损失函数如下:

L=Lce+λ×Ldice

Lce 为交叉熵损失,λ 为平衡超参数,这里设置为0.5。

工程实践

1. 环境安装

In [ ]!pip install -r work/requirement.txt登录后复制

2. 数据集生成

In [ ]!ls data/data127971 # show the raw directory!unzip data/data127971/dehw_train_dataset.zip -d data/ # extract the train data!unzip data/data127971/dehw_testA_dataset.zip -d data/ # extract the test data!python work/generate_files.py --trainData 1 --root data/dehw_train_dataset/images # generate the train list!python work/generate_files.py --trainData 0 --root data/dehw_testA_dataset/images # generate the test list登录后复制

3. 训练模型

In [ ]!python work/main.py --train 1 --arch segformer_b2 --num_epochs 10 --batchSize 24 --dataRoot data/dehw_train_dataset登录后复制

4. 结果生成

In [ ]!python work/main.py --train 0 --arch segformer_b2 --modelLog Log/segformer_b2/02131458.pdparams --dataRoot data/dehw_testA_dataset登录后复制

相关攻略

Pywinrm 通过Windows远程管理(WinRM)协议,让Python能够像操作本地一样执行远程Windows命令,真正打通了跨平台管理的最后一公里。 在混合IT环境中,Linux机器管理Wi

早些时候,聊过 Python 领域那场惊心动魄的供应链攻击。当时我就感叹,虽然我们 JavaScript 开发者对这类套路烂熟于心,但亲眼目睹这种规模的“投毒”还是头一次。 早些时候,聊过 Pyth

Toga 是 BeeWare 家族的核心成员,号称“写一次,跑遍所有平台”,而且用的是系统原生控件,不是那种一看就是网页套壳的界面 。 写了这么多年 Python,你是不是也想过:要是能一套代码跑

异常处理的核心:让错误在正确的地方被有效处理。正确的地方,就是别在底层就把异常吞了,也别在顶层还抛裸奔的 Exception。 异常处理写得好,半夜不用起来改 bug。1 你是不是也这么干过?tr

1 Skills机制概述 提起OpenClaw的Skills机制,不少人可能会把它想象成传统意义上的可执行插件。其实,它的内涵要更精妙一些。 简单说,Skills本质上是一套基于提示驱动的能力扩展机制。它并不是一个可以独立“跑”起来的程序模块,而是通过一份结构化描述文件(核心就是那个SKILL m

热门专题

热门推荐

加密货币行业翘首以盼的监管里程碑,终于有了实质性进展。美国证券交易委员会(SEC)主席保罗·阿特金斯(Paul Atkins)近日证实,那份允许加密项目在早期获得注册豁免权的“安全港”框架提案,已经正式送抵白宫,进入了最终审查阶段。 在范德堡大学与区块链协会联合举办的数字资产峰会上,阿特金斯透露了这

微策略Strategy报告:第一季录得144 6亿美元浮亏 再斥资约3 3亿美元买进4871枚比特币 市场震荡的威力有多大?看看Strategy的最新季报就明白了。根据其最新向美国证管会(SEC)提交的8-K报告,受市场剧烈波动影响,这家公司所持的比特币在第一季度录得了一笔惊人的数字——144 6亿

稳定币巨头Tether的动向,向来是加密世界的风向标。这不,它向Web3基础设施的版图扩张,又迈出了关键一步。公司执行长Paolo Ardoino在社交平台X上透露,其工程团队正在全力“烹制”一个新项目——去中心化搜索引擎 “Hypersearch”。这个消息一出,立刻引发了行业的广泛猜想。 采用D

基地位于Coinbase旗下以太坊Layer2网络Base的Seamless Protocol,日前正式宣告了服务的终结。这个曾经吸引了超过20万用户的原生DeFi借贷协议,在运营不到三年后,终究没能跑赢时间。它主打的核心产品是Integrated Leverage Markets(ILMs)——一

PAAL代币揭秘:深度解析Web3社区治理的核心钥匙 在去中心化自治组织的浪潮中,谁真正掌握了项目的话语权?PAAL代币提供了一套系统化的答案。它不仅是生态内流转的价值媒介,更是开启链上治理大门的核心凭证。通过持有并质押PAAL代币,用户能够对协议升级、资金分配乃至战略方向等关键事务投出决定性的一票