DeepSeek-R1模型本地部署如何选择版本(硬件要求与适用场景)

关注公众号回复“激活码”,获取最新idea激活码。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

自然语言处理(NLP)技术已成为数字化转型的核心推动力,近期备受瞩目的DeepSeek-R1作为新一代智能语言模型,在语义理解、推理能力和生成质量上取得了突破性进展。DeepSeek团队通过研究证明,较大模型的推理模式可以被精炼成较小的模型,并在性能上优于通过强化学习(RL)在小模型上发现的推理模式。结合最新的硬件发展趋势,本文为您提供精准的部署版本选择建议,希望能帮助您在不同场景下最大化发挥模型效能。

DeepSeek-R1模型概述该模型系列采用MoE(混合专家)架构,支持从移动端到超算集群的弹性部署:

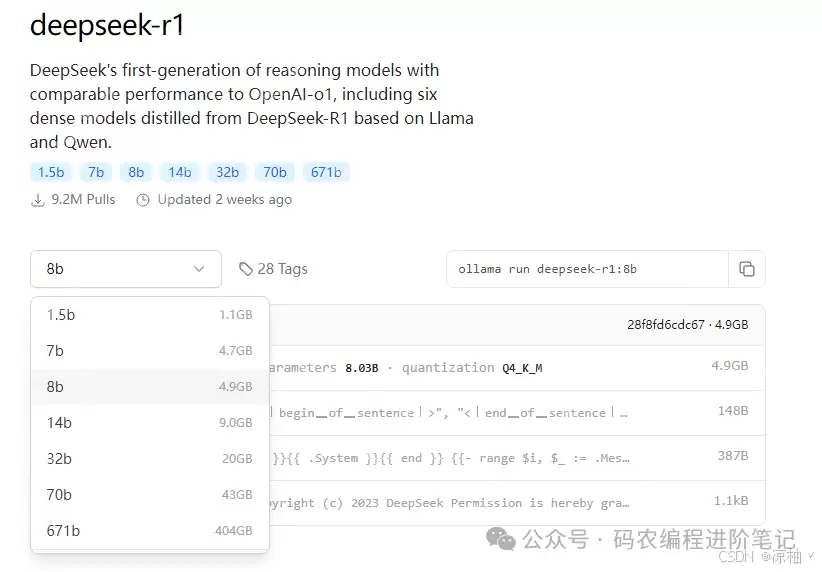

参数规模:覆盖1.5B至1.8T参数,支持动态子模型激活。技术特性:集成Flash Attention 3、动态量化推理和专家路由优化。性能优势:相比传统架构,推理速度提升40%且显存占用降低30%。通过ollama下载DeepSeek-R1模型地址:deepseek-r1。

硬件要求根据计算密度需求提供两套配置方案:

硬件选型建议:

CPU:推荐AMD Zen4或Intel Sapphire Rapids架构,支持AVX-512指令集。GPU:NVIDIA Ada Lovelace架构(RTX 40/50系列)或Hopper架构(H100)。存储:PCIe 5.0 NVMe SSD,建议配置RAID 0提升I/O性能。内存:DDR5 5600MHz以上,支持ECC校验。适用场景:

轻量级部署:

1.5B版本:适用于边缘计算设备,如工业控制终端、智能家居中枢。7B-8B版本:适合个人开发者工作站,支持代码生成、文档处理等任务。企业级部署:

14B-32B版本:满足企业知识管理、合同分析、报告生成等需求。70B版本:适用于金融分析、医疗诊断等专业领域。科研级部署:

671B版本:支持多模态大模型训练、复杂科学计算任务。性能优化建议:

量化加速:使用FP8/INT8量化提升推理速度。显存优化:启用ZeRO-3优化器减少显存占用。分布式部署:采用Tensor Parallelism+Pipeline Parallelism。缓存机制:实现KV Cache优化。注意事项:

确保硬件兼容性,特别是GPU驱动版本。部署前进行完整的压力测试。配置完善的日志系统。制定应急预案。在模型部署后,建议持续监控系统资源使用情况,以确保模型运行稳定。可以使用工具如htop或nvidia-smi来监控CPU、内存和显存的使用情况。

相关攻略

Windows系统下,如何精准获取显卡实时功耗?这五种方法你得知道 在Windows系统里想查看显卡当前到底“吃了”多少电,却发现任务管理器要么没有“功耗”这一项,要么只给个笼统的“低、中、高”能耗等级?这多半是驱动版本、WDDM图形架构兼容性,或是系统自身监控能力的限制。别着急,下面这五种实测有效

Windows 10右键菜单冗余项清理指南 相信不少用户都遇到过这样的困扰:在Windows 10系统中右键点击文件或桌面时,弹出的菜单里挤满了早已卸载软件留下的“僵尸选项”。这些看似不起眼的冗余项,其实都是注册表里未被清理的上下文菜单扩展在作祟。今天就给大家带来三种从根源上解决问题的清理方案。 一

苹果iPhone官网入口 你是不是也经常在网上搜“苹果官网iPhone入口在哪”?别找了,最直接、最官方的地址就是这个:https: www apple com cn iphone 。直接收藏这个链接,下次就不用再绕弯路啦。 话说回来,这个官网可不仅仅是卖手机的一个页面。它更像是一个集展示、对比、

不知道你有没有遇到过这种情况:站在台上讲PPT,台下却一片沉寂,或者观众眼神明显已经开始飘忽不定。说实话,这感觉确实挺受挫的。很多时候,问题不在于内容本身,而在于我们的幻灯片更像是一本单向展示的“电子书”,缺少了和观众“对话”的能力。不过,现在我们手里多了一副新牌——AI工具,它能让你的PPT变得聪

一、在受信任的苹果设备上直接更改密码 说实话,这可能是最方便、体验也最流畅的一种方法了。它巧妙地利用了设备本身已经对你的“信任”——也就是你的锁屏密码或生物识别(面容 触控ID)。这样一来,系统就确认了“你就是你”,完全绕开了让你头疼的那个Apple ID密码验证环节。整个过程,就像是在家里修改Wi

热门专题

热门推荐

用模型换真手机?网上学无痕拆封手机反诈超 3 万元终被判刑 电商平台的“七天无理由退货”政策,本是为了保障消费者权益,如今却被少数人钻了空子,玩起了“狸猫换太子”的把戏。最近,广东肇庆市高要区人民法院就公开宣判了这么一起案子,主角的操作手法,可以说是把“技术”用错了地方。 事情要从2022年底说起。

《红色沙漠》阿比斯库图姆无伤打法分享 在《红色沙漠》中,异型BOSS阿比斯库图姆以其机械沙虫般的独特外形和强大的攻击力,成为许多玩家攻略路上的难点。其战斗场面压迫感十足,但无需过度担忧。只要掌握正确的策略与技巧,实现无伤击败是完全可行的。本文将为你详细解析高效安全的通关方法。 红色沙漠阿比斯库图姆怎

胡润百富榜:一个洞察全球商业脉搏的窗口 说到胡润百富榜,很多朋友的第一反应可能是那份耳熟能详的中国富豪排名。其实,它的内涵远比一个榜单丰富得多。这更像是一个系统性的商业生态观察平台,旨在从财富、企业、创业、教育等多个维度,全景式地扫描全球商业精英与高潜力机构。 其官方网站(https: www h

Cate币:一个正在崛起的自动化交易生态代币 在眼花缭乱的数字货币世界里,有一个名字正逐渐引起投资者的注意:Cate币。它的全称是CryptototemAutomativeTradingExcellence,中文译作“加密神兽汽车卓越交易币”。顾名思义,这个项目从一开始就瞄准了自动化交易这个细分赛道

DOT币:波卡生态的核心燃料与跨链未来 在区块链技术从“孤岛”走向“互联”的演进中,一个名字被反复提及——DOT币,即波卡币。它并非凭空出现,其背后是区块链领域的技术巨擘:以太坊联合创始人Ga vin Wood博士。2016年,他提出了对区块链互操作性瓶颈的深刻思考,并最终催生了Polkadot网络