DeepSeek最简单搭建方法(win版本)

1.下载ollama

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

Ollama 是一个开源的大型语言模型(LLM)本地化部署框架,旨在简化用户在本地运行和管理大模型的流程。

https://ollama.com/download登录后复制

2.安装Ollama

安装过程与普通软件类似,只需双击exe文件即可完成安装。安装成功后,打开命令提示符,如下图所示。

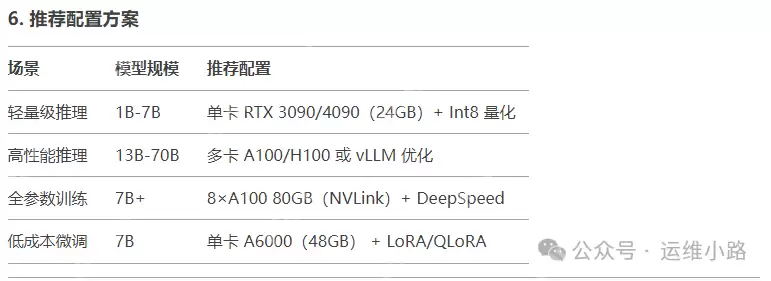

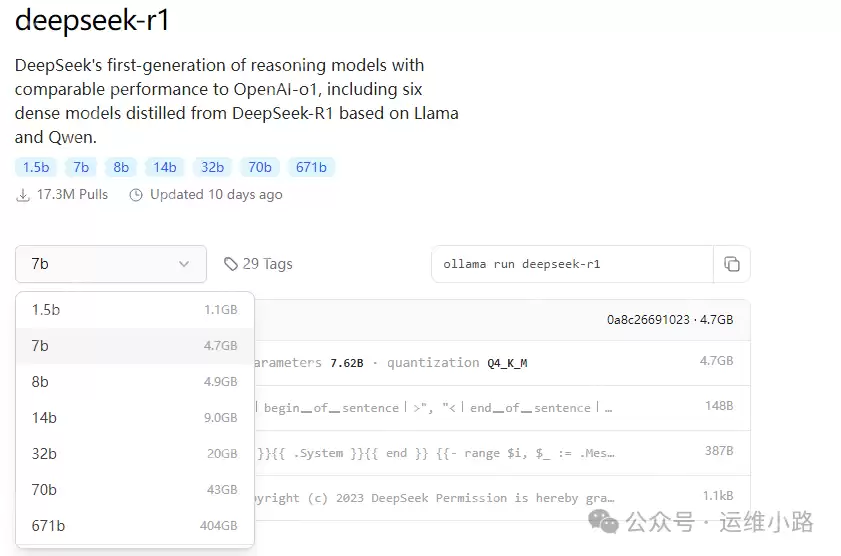

3.下载并运行模型

有多种模型可供选择,不同模型对配置的要求不同。如果仅使用CPU或只是体验功能,可以选择1.5b模型。下图展示了DeepSeek模型的推荐配置。

本次演示的服务器配置:CPU:I5 8400;内存:32G;显卡:两个显示器,一个接主板集成显卡,一个接独立显卡(亮机卡)。

https://ollama.com/library/deepseek-r1登录后复制

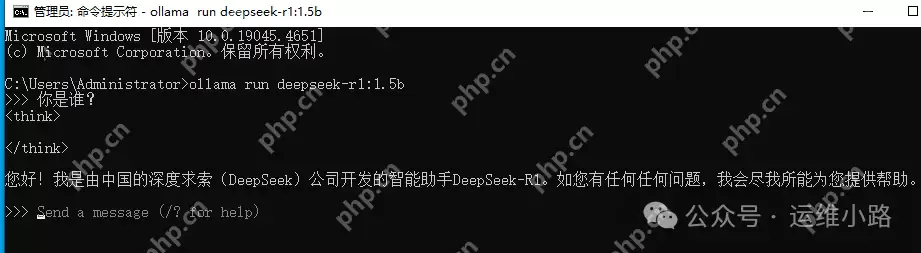

ollama run deepseek-r1:1.5b登录后复制

执行此命令后,模型会开始下载。下载速度开始时较快,后续会变慢。下载完成后会显示如下图所示的界面(由于我这里是关闭后重新运行的,所以看不到下载界面)。

4.提问

由于没有其他接口来调用这个API,这里只能通过控制台进行访问。

5.接入第三方工具

https://cherry-ai.com/#下载并安装客户端登录后复制

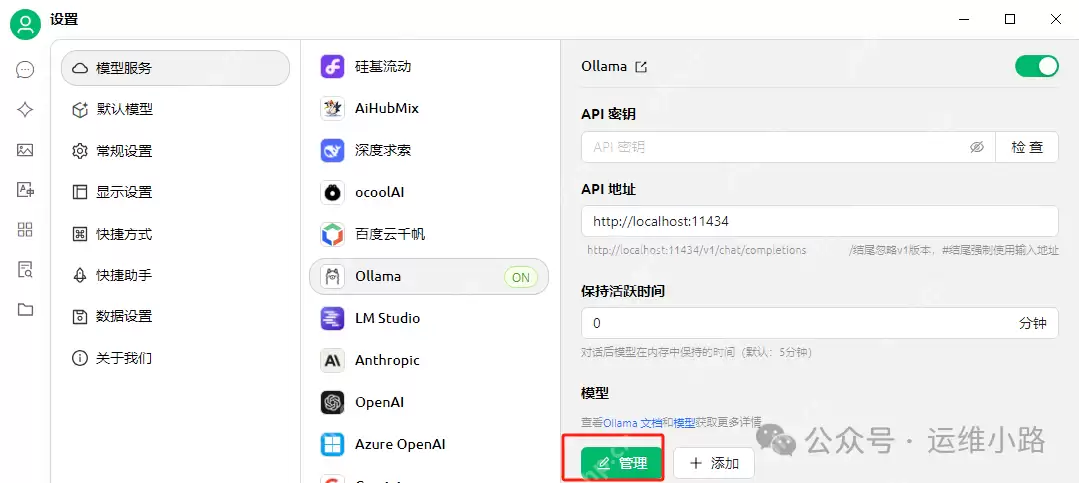

参考下图进行配置,选择管理,然后点击添加你本地的模型(它会自动识别你本地安装过的模型)。

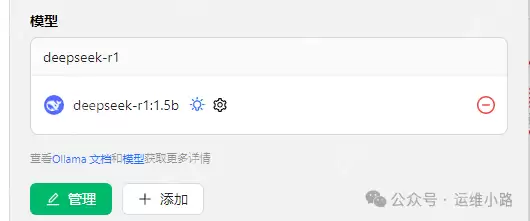

添加成功后,你可以看到本地的模型版本。

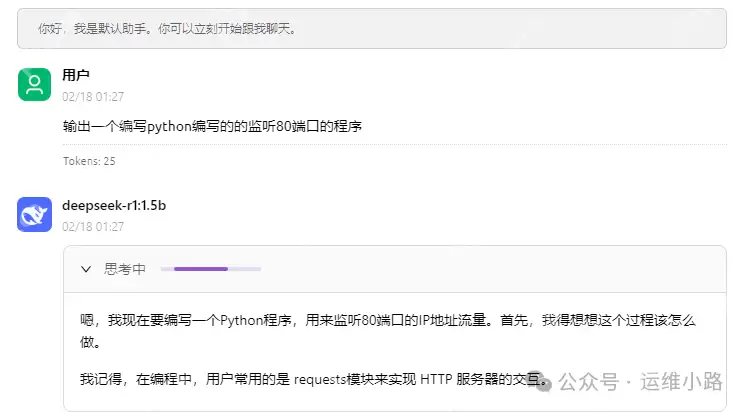

6.开始对话

回到工具左上角的对话界面,就可以进行对话。这里我们可以选择一个较为复杂的逻辑进行测试。

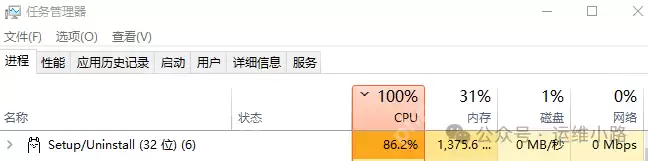

7.资源监控

从这里可以看到在回答问题时,CPU占用率很高,但内存占用率不是很高。当然,我选择的低配模型回答效果可能不如高配模型,但对于入门体验是足够的。

相关攻略

一个月费$200的Claude Max订阅,用出了$5000的算力价值——这件事最终让Anthropic下定决心,彻底关上了第三方工具“蹭订阅”的大门。北京时间4月4日,Anthropic向订阅用户

IT之家 4 月 4 日消息,国外维修团队 iFixit 昨日发布视频,拆解苹果 AirPods Max 2,发现其内部结构与初代产品高度相似,可沿用旧版拆解手册。IT之家附上相关拆解视频如下:iF

每日经济新闻4月1日消息 当地时间3月31日,被视为OpenAI最强竞争对手的Anthropic再次遭遇代码泄露事件,是其在一周内遭遇的第二起重大数据失误事件。Anthropic因npm包打包失误,

IT之家 3 月 31 日消息,据《滚石》杂志的深度调查显示,AI 生成工具正迅速渗透专业音乐制作领域,但整个行业却对此讳莫如深。今年早些时候,Suno 首席执行官米奇 · 舒尔曼接受《卫报》采访时

克雷西 发自 凹非寺量子位 | 公众号 QbitAIAI进入营销行业,已经是定局。艾瑞咨询报告显示,去年中国AI营销市场规模达669亿元,年复合增长率26 2%这个增速背后,是整个行业链条——从内容

热门专题

热门推荐

加密货币行业翘首以盼的监管里程碑,终于有了实质性进展。美国证券交易委员会(SEC)主席保罗·阿特金斯(Paul Atkins)近日证实,那份允许加密项目在早期获得注册豁免权的“安全港”框架提案,已经正式送抵白宫,进入了最终审查阶段。 在范德堡大学与区块链协会联合举办的数字资产峰会上,阿特金斯透露了这

微策略Strategy报告:第一季录得144 6亿美元浮亏 再斥资约3 3亿美元买进4871枚比特币 市场震荡的威力有多大?看看Strategy的最新季报就明白了。根据其最新向美国证管会(SEC)提交的8-K报告,受市场剧烈波动影响,这家公司所持的比特币在第一季度录得了一笔惊人的数字——144 6亿

稳定币巨头Tether的动向,向来是加密世界的风向标。这不,它向Web3基础设施的版图扩张,又迈出了关键一步。公司执行长Paolo Ardoino在社交平台X上透露,其工程团队正在全力“烹制”一个新项目——去中心化搜索引擎 “Hypersearch”。这个消息一出,立刻引发了行业的广泛猜想。 采用D

基地位于Coinbase旗下以太坊Layer2网络Base的Seamless Protocol,日前正式宣告了服务的终结。这个曾经吸引了超过20万用户的原生DeFi借贷协议,在运营不到三年后,终究没能跑赢时间。它主打的核心产品是Integrated Leverage Markets(ILMs)——一

PAAL代币揭秘:深度解析Web3社区治理的核心钥匙 在去中心化自治组织的浪潮中,谁真正掌握了项目的话语权?PAAL代币提供了一套系统化的答案。它不仅是生态内流转的价值媒介,更是开启链上治理大门的核心凭证。通过持有并质押PAAL代币,用户能够对协议升级、资金分配乃至战略方向等关键事务投出决定性的一票